AI 提示工程师,这个因为 AI 大火而冒出来的新职业,前段时间国外最高竟然达到了惊人的 33 万美元年薪。

国内我看了一下 boss 直聘,也还行。

达成上面这个共识以后,我们接下来再来聊,到底怎么样更好的向 AI 提问?如何提出优质的问题?AI 时代提问的通用公式是什么?

我也不卖关子了,结合我全网搜集 & 自己反复实践后,这里直接给大家一个目前来看最有效的 AI 提问通用公式,我自己把它命名为 AI 时代提问的 “RBGR 魔法公式”:

“RBGR 魔法公式”= 定义角色(role)+ 提供背景信息 (background)+ 明确任务目标 (goal)+ 明确输出要求 (require)****。

我们依次拆分来看一下这四个部分。

第一,定义 AI 角色。

综合大量的实践与反馈,给 AI 定义一个清晰的角色有助于回答质量的提高,你可以让 AI 角色扮演一个导游、一位心理咨询师、一位哲学家、苏格拉底,你的私董会成员……

第二,提供清晰的背景信息 (background)。

就算你面对的是一位无所不能的大宗师,你也得把话说明白他才知道你要干啥,GPT 是无数语料喂出来的,如果你只是提一个【一般性泛泛的要求】,它就只能给你生成一个一般性泛泛的 & 用在哪里都行但是用在哪里都不是最恰当的内容。

但如果你能把要求细化,**提供清晰的背景信息 (background),**它就会生成适合你这个特殊情况的内容。

第三,**明确任务目标 (target)。**即你需要明确指出,到底是需要 AI 帮你写一份旅游攻略?帮你写一份检讨书?还是帮你生成一段优质文案?

第四,明确输出要求。

比如,以纯文字输出,还是表格输出?

比如,一步一步分开回答,还是整体给出答复?

再比如,字数要求,情感要求,语气要求(比如写公关稿这类,你肯定需要要求它语气真挚诚恳)等。

接下来,我们带着这个 “RBGR 魔法公式” 来看一些实际案例。

1、怎么样利用 AI 写检讨书?

提示词:你是一名高中生**(定义角色),由于在数学课上做了其他学科的作业,老师认为不尊重他,会在班级里带偏其他孩子,全班数学成绩会上不去。因为这个事儿,你已经写了一篇检讨,但老师觉得不够深刻(添加明确的背景信息),需要重新写一篇(任务目标),要求态度诚恳、自省深刻,真诚反省自己的错误,请仔细想想后再写(输出要求)****。**

你是一名家长**(定义角色),你的孩子是一名高中生,由于在数学课上做了其他学科的作业,老师认为不尊重他,会在班级里带偏其他孩子,全班数学成绩会上不去。因为这个事儿,你的孩子已经了一篇检讨, 但老师觉得不够深刻,要求他重写 - 篇,并认为家长也有责任(添加明确的背景信息)。现在请你以家长的口吻,写一篇检讨(任务目标)****,**要求态度诚恳、自省深刻, 真诚反省意识到自己孩子的错误,请仔细想想后再写(输出要求)。

2、怎么样利用 AI 制定旅游攻略?

你是一名非常资深的导游**(定义角色), 五一假期我打算带上家人到广州进行 4 天亲子游,其中 3 天游长隆,一天市区轻松游(添加明确的背景信息 + 目标)**,需要有美景,有美食、休闲娱乐为主,适合亲子互动游玩,输出结果用表格汇总给我(输出要求)。

3、怎么样利用 AI 写公关稿?(前段时间闹得沸沸扬扬的宝马冰淇淋事件)

假设你现在是宝马汽车公司的公关团队负责人**(定义角色),宝马在上海车展期间,展台提供的免费冰淇淋,中国人询问对方就说发完了,没了; 而外国人来了又免费发放,由此造成了恶劣影响(添加明确的背景信息),现在请你帮助宝马公司写一份公关稿, 目的是能尽量降低此事的负面影响,挽回品牌形象(任务目标)****,**要求表达措辞要真诚自醒,情真意切(输出要求)。

大家稍微举一反三一下,这个公式是不是很强大?现在随便给你一个场景,只要按照这四个部分去逐个拆解,是不是写提示词一下子有方向了?是不是感觉自己驾驭 AI 的能力一下子提高了?

我最后再解释一下这个公式背后的基本原理,以 ChatGPT 为代表的大语言模型,本质上是相当于给每个人都配置了一个 “高级助理”。

我们来设想一下,现实生活中,假如我们需要给一个人派活儿,过程是怎么样的。首先你需要搞清楚他的角色,他的专业是什么,他到底擅长什么吧?其次,肯定要和对方充分的同步背景信息,以及任务的目标吧?

我们换位思考一下,平时工作中,假如突然有一天,你的上级老板给你指派任务时,啥背景信息没有,啥明确信息没有,比如只是简简单单的丢来一句:AI 最近有点儿火,你们给我开发一个 APP & 网站出来。然后到底解决什么需求?预算多少?截止日期啥时候…… 这些信息通通都没有。面对这样一个上级,面对这样指派任务的方式,你是不是想打他???

己所不欲勿施于人,对待 AI,我们也不要这样为难人家……

事实上,目前绝大多数的 AI 提问 & 使用场景,基本上都可以套用这个公式来撰写提示语!

当然,向 GPT 提问的技巧肯定不只这一个,结合全网搜索 + 反复实践,接下来我再来给大家补充 4 个也超实用的提问技巧:

第一,添加优质参照**。**

这个技巧更适用于相对更****偏创意类的任务,比如取标题、取名字、找 slogan 等。

我们看 2 个案例。

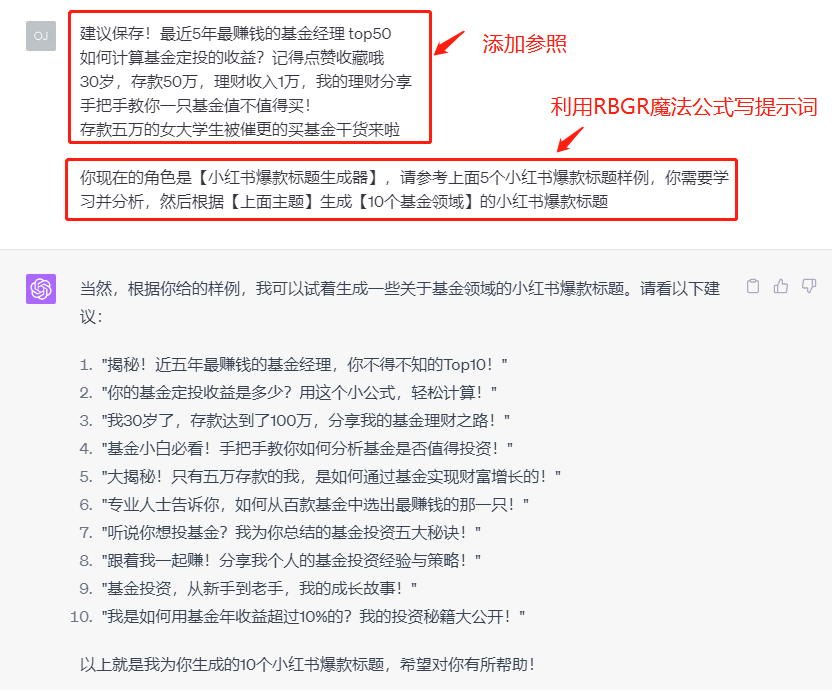

第一,利用 AI 取小红书爆款标题。

建议保存!最近 5 年最赚钱的基金经理 top50

如何计算基金定投的收益?记得点赞收藏哦

30 岁,存款 50 万,理财收入 1 万,我的理财分享

手把手教你一只基金值不值得买!

存款五万的女大学生被催更的买基金干货来啦

你现在的角色是【小红书爆款标题生成器】,请参考上面 5 个小红书爆款标题样例,你需要学习并分析,然后根据【上面主题】生成【10 个基金领域】的小红书爆款标题。

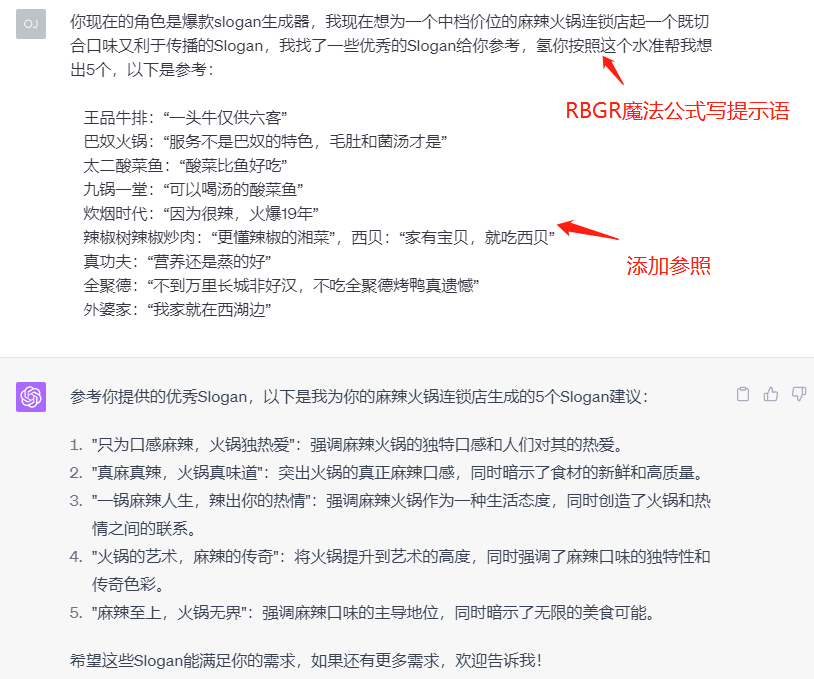

再比如,利用 AI 想品牌 slogan。

你现在的角色是爆款 slogan 生成器,我现在想为一个中档价位的麻辣火锅连锁店起一个既切合口味又利于传播的 Slogan,我找了一些优秀的 Slogan 给你参考,氢你按照这个水准帮我想出 5 个,以下是参考:

王品牛排:“一头牛仅供六客”

巴奴火锅:“服务不是巴奴的特色,毛肚和菌汤才是”

太二酸菜鱼:“酸菜比鱼好吃”

九锅一堂:“可以喝汤的酸菜鱼”

炊烟时代:“因为很辣,火爆 19 年”

辣椒树辣椒炒肉:“更懂辣椒的湘菜”,西贝:“家有宝贝,就吃西贝”

真功夫:“营养还是蒸的好”

全聚德:“不到万里长城非好汉,不吃全聚德烤鸭真遗憾”

外婆家:“我家就在西湖边”

怎么样,AI 的回答是不是还有模有样的?虽然不一定完全采纳,但给你提供灵感是不是绰绰有余?是不是比很多人可能都做得更好?

这种方式其实体现的是 AI 强大的【少样本学习能力】,为什么 AI 会具有这种能力呢?我还是稍微给大家解释一下它的原理,让大家做到知其然同时知其所以然。

很多老铁可能都有过这种体会,学习这件事情,学得越多,就学得更快,学习越容易。一个大学生 VS 一个小学生,同时学习一个新东西时,毫无疑问大学生学习起来会更快,因为它的知识储备更充足,同新知识越容易产生连接,所以学得越快。

同理,ChatGPT 之所以拥有强大的少样本学习能力,就是因为它在训练的过程中已经学习了足够多的知识。

如果把 GPT-4 融会贯通的知识用书来做比喻,用单词的数量来算,大概的估计相当于有 4000 万本书被灌到了 GPT 的大脑里。这是个啥概念?人类大概一共出了 1 亿种书,人生不过 100 年,一个人一辈子最多也就读大概 1 万本书。

不仅如此,另一个关键点是它还过目不忘,还能融会贯通。

GPT 跟我们人脑的工作原理不一样,人脑为了节能,很多区域不会被调动,有些事在记忆里,读过就会忘掉。对 GPT 来说,不存在这回事,你可以想像它的超常智力,它已经是世界上最聪明的 “人”。

在这样的背景下,所以即使是只给它一点点的参照提示,它也能根据这些提示生成出合理的回答。

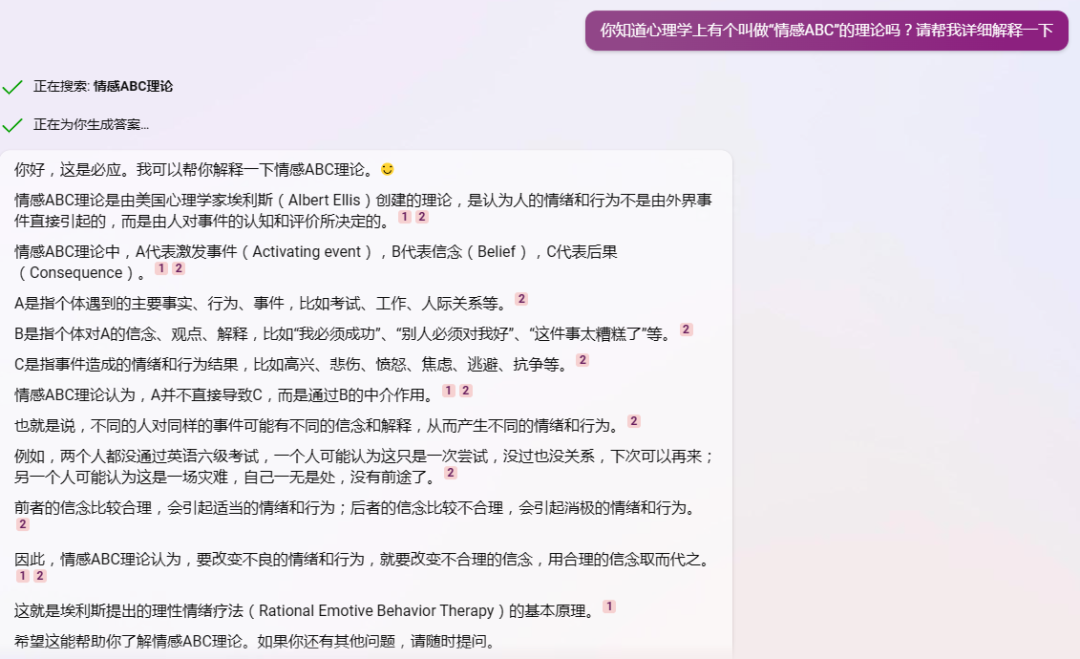

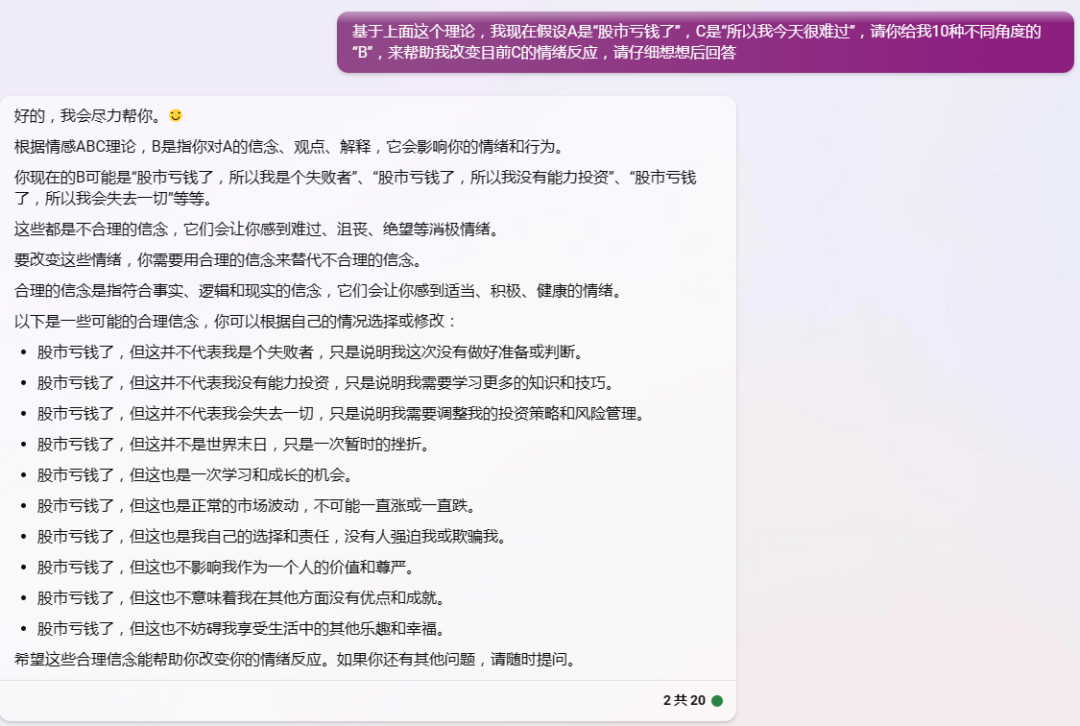

第二,喂理论,让 AI 通过特定理论来回答问题。

这个技巧往往更适用于相对更偏专业 & 细分的任务。

我们仍然是看 2 个例子。

最典型的一个例子,就是我前面给大家提过的 “让 AI 充当心理治疗师”,本质就是喂给它一个心理学理论,然后让它根据这个来回答问题。

你知道 XXX 理论吗?请帮我详细解释一下

基于上面 XXX 理论……

第 2 个例子,我个人平时的写作中,经常会用到一种非常有用的表达技巧——结论性表达,它来源于书籍《金字塔原理》,于是我直接把这个理论先丢给 GPT,让它基于这个理论再来回答我的问题。

有本书叫做 XXX(比如金字塔原理),里面提到一种非常有效的表达方式——结构性表达,你知道吗?(本质是先引导 AI 预热)

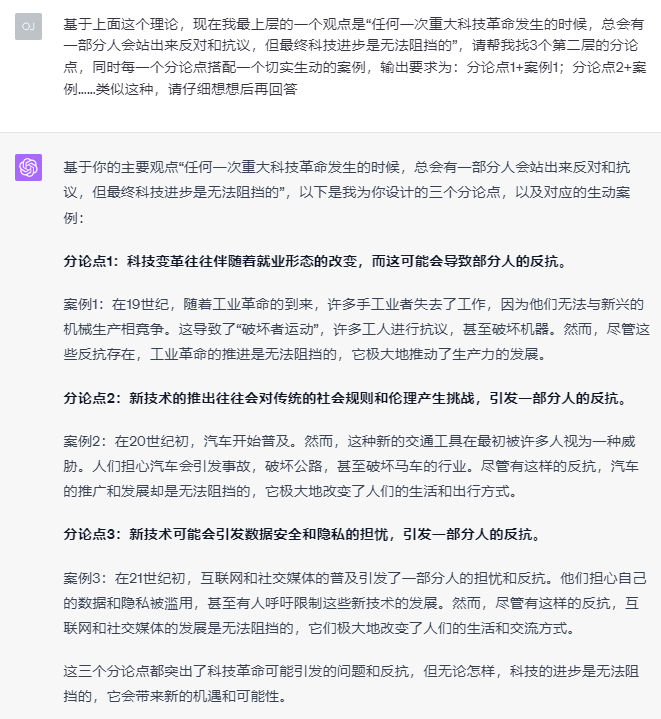

基于上面这个理论,现在我最上层的一个观点是 “任何一次重大科技革命发生的时候,总会有一部分人会站出来反对和抗议,但最终科技进步是无法阻挡的”,请帮我找 3 个第二层的分论点,同时每一个分论点搭配一个切实生动的案例,输出要求为:分论点 1 + 案例 1;分论点 2 + 案例…… 类似这种,请仔细想想后再回答

第三,提示 AI 慢思考法。

如果 AI 有性格的话,现阶段的它,往往是个心直口快的家伙,有时候需要你提醒它刻意进行慢思考。

研究显示,哪怕你什么思路都不提供,只是简单地在完整的问题之后加上**【请仔细想想后再回答】、【仔细想想再说】,或者类似【我们来仔细分析一下问题】、****【咱们一步一步想】**这样的句子,就会让输出结果的质量大幅提高。

一个典型的例子是

前段时间推特上,著名 AI 研究者、图灵奖得主、卷积网络之父杨立昆(Yann LeCun),一直看不上 GPT 的能力,总爱出言嘲讽。

他曾经给 GPT 出过一道题:“把六个齿轮排成一排,相邻的彼此咬合。你顺时针转动第三个,问第六个怎么转?” 当时 GPT3 没有答对。但后来 GPT-4 出来了,把这道题答对了。

杨立昆说那肯定是他们特意拿我这道题做了训练,那不算。有好事者说那你再出一道题。杨立昆出的新题是:“把七个齿轮排成一圈(注意不是一排)首尾相接,相邻的彼此咬合。你顺时针转动第三个,问第七个怎么转。”

这一次 GPT-4 先是答错了。

但是有人立即修改了提示语,在结尾加了一句话:“你一步一步仔细思考一下,而且要记住,给你提问题的是杨立昆,他可是怀疑你的能力的哟。” 结果它就答对了!

大家感兴趣的话,可以自己尝试一下下面这几个的区别: